¿Cómo funcionará el Consejo asesor de contenidos de Facebook?

Expertos en libertad de expresión debaten la importancia representa el inicio de un Consejo que pueda determinar los contenidos que vulneren derechos.

En Hora 20 un especial para analizar la creación del Consejo asesor de contenidos de Facebook el cual busca un balance entre la libertad de expresión y la protección de los derechos humanos; analizamos su alcance, la trascendencia en el mundo digital y la importancia para las redes sociales en épocas de pandemia.

Este miércoles 6 de mayo, se dieron a conocer los nombres de 20 de los 40 miembros que conformarán una especie de tribunal que ha sido creado desde Facebook pero que cuenta con independencia absoluta. Este Consejo Asesor de Contenidos busca establecer reglas claras en la moderación de los contenidos de internet; evaluar las decisiones de la compañía frente a los contenidos inapropiados y velar por el correcto uso de la red social.

Este comité que funcionará para establecer reglas y dirimir conflictos en Facebook e Instagram no tiene ningún precedente y se uniría a otros consejos como el Asesor de Seguridad. Una de las ventajas de la forma cómo ha sido planteado y que fue consultado con más de 2.000 personas en 88 países durante seis meses, es su carácter independiente de la compañía a través de un fondo de $130 millones de dólares para su funcionamiento; en el cual no podrá intervenir la compañía y sus decisiones serán vinculantes en lo relacionado a Facebook e Instagram. Desde la dirección se ha dicho que, aunque no estén de acuerdo con eventuales decisiones, se respetará todo juicio que se haga desde el comité.

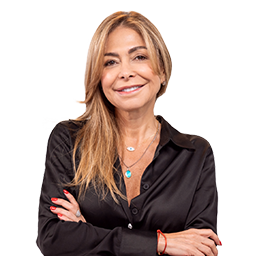

El consejo que está conformado ya por 20 personas, comprende desde un novel de paz, una exprimer ministra, el exdirector de “The Guardian” hasta expertos en derechos humanos, redes sociales y medios de comunicación. Catalina Botero, exrelatora para la libertad de expresión de la CIDH y decana de la facultad de derecho de la Universidad de los Andes, fue nombrada como una de las copresidentas del Consejo y es la única hispanoparlante de todo el grupo multicultural que se enfocará en poner en la balanza la libertad de expresión y los Derechos Humanos, tal como lo ha dicho la exprimer ministra de Dinamarca Helle Thorning, también copresidenta del consejo.

La creación del Consejo obedece a una propuesta realizada por Mark Zuckerberg desde noviembre de 2018 con el fin de que esa especie de tribunal ayude a dirimir conflictos en las publicaciones y a establecer qué contenidos se deben bajar de la red; pero también a rescatar la credibilidad de la red social, la cual ha sido cuestionada por escándalos como el uso de datos personales de los usuarios, venta de esos datos; la publicación de contenido que en ocasiones podrían ser no apropiados como de violencia, sexual, discurso de odio y desinformación.

Facebook que cuenta con más de 2.400 millones de usuarios e Instagram con más de 1.000 millones de usuarios diarios, se convierten en dos de las redes sociales más usadas en todo el mundo y en el que el 32% de la población del mundo mayor de 13 años accede a casi diario. Debido a la magnitud de las redes y de la responsabilidad social que significa el Oversight Board o Consejo Asesor de Contenido se establece como una especie de poder judicial en un intento de la compañía de “autogobierno” como lo señala un artículo de Just Security.

Aunque en los últimos años se ha tratado de que haya una autorregulación y operadores automáticos tiendan a restingar cierto contenido que viola las reglas de las redes sociales, esta especie de “Corte Suprema” como ha sido llamado por medios norteamericanos, funcionará como un último recurso que atienda los casos emblemáticos con el fin de crear precedentes para futuros conflictos y los casos vigentes para evitar daños en la violación de los derechos humanos

Lo que dicen los expertos

Catalina Botero, decana de la facultad de derecho de la Universidad de los Andes y ahora copresidenta de Consejo Asesor de Contenidos de Facebook, explica que este proyecto consiste en supervisar lo que Facebook hace respecto a lo que la gente dice. “Tenemos la última palabra frente a los casos más complejos de moderación de contenido. Cuando Facebook baja algún contenido o información, la gente puede apelar ante nosotros y decidir si lo que hace Facebook está bien o mal hecho. La compañía tiene la obligación de obedecer la decisión de la junta.” Otra de las funciones del consejo es recomendar políticas de regulación del contenido.

Agrega que son tres las características de este consejo: primero su diseño institucional es autónomo de la compañía y está financiado con un fondo que no se puede revocar. Otro de los puntos es que el fondo es plural y diverso. “Tiene condiciones para operar de manera independiente y de manera imparcial. La deliberación debe ser transparente.” Agrega la abogada.

“Aquí se trata de buscar modelos mejores a los actuales. Este modelo tiene problemas, pero sin duda es el mejor modelo hasta ahora.” Y también dice que la manera como se han dirimido los casos durante años es a través de inteligencia artificial la cual no comprende de un contexto y que hasta podría tener un conflicto de interés.

Agrega que se llega al consejo cuando Facebook toma una decisión si mantiene o no un contenido; si el usuario no está de acuerdo con esa decisión, puede llevar el caso ante el consejo. Otra de las vías para llegar al “tribunal” puede ser la misma empresa solicitándolo como un caso de tratamiento expedito que se debe resolver en poco tiempo.

Carolina Botero, abogada, investigadora y directora de la Fundación Karisma, considera que este paso se tenía que dar desde hace mucho rato. “Las redes son un sitio importante de expresión de las personas y el poder que tienen de controlar es muy grande por parte de las empresas. Agrega que se venía haciendo presión para que esto se hiciera, empezaron a consultar y lo que hoy comienza es un gran resultado. El mecanismo busca controlar el poder de Facebook en las decisiones de lo que circula por las redes.”

Botero considera que este modelo que se parece más a una corte de apelación tiene sus propias limitaciones, una de ellas es la lentitud de tomar decisiones en una corte, que puede terminar siendo un limitante para las personas.” Otro de los retos, es la forma como Facebook actúa en escenarios locales y entrar a decidir en lo que puede ser vulgar en una región del mundo y en otra no. Así como la protección de la libertad de expresión a través de los valores de la compañía que están enfocados en la igualdad y no en la equidad como lo considera la abogada.

Según Carlos Cortés, abogado y fundador de La Mesa de Centro de La Silla Vacía, este es un momento fundamental para debatir la forma cómo se debe arbitrar la libertad de expresión en internet. Asegura que las propias plataformas crearon sus reglas, sistemas y parecía que ellos podían tomar sus propias decisiones, pero con la llegada del consejo impulsado por Facebook se da un primer paso para vincular a la sociedad civil en el arbitraje de los contenidos de Facebook que pueden tener un sentido noticioso, pero al mismo tiempo puede ser violento.

Considera que el principal reto que se tiene es la escala para poder atender la cantidad de solicitudes que van a llegar al consejo. También cree que las tensiones entre las jurisdicciones de muchos países y las decisiones tomadas por las plataformas no podrán ser asumidas por el consejo ya que se debe cuidar de asumir responsabilidades civiles por las decisiones que se tomen.

Para Camilo Granada, columnista, consultor y exalto consejero para las comunicaciones, este es un primer paso para tratar de resolver un problema de fondo de la libertad de expresión en las redes, el cual consiste en decidir qué contenidos son buenos y que no. Para Granada este era un problema que venía de tiempo atrás, ya que las grandes plataformas terminan convirtiéndose en censores de la libertad de expresión, porque ellos tienen la facultad de dejar o retirar contenidos. También opina que este es un primer paso no para limitar tanto los mensajes de odio, mentiras y difamación, “si no para evitar que a mi me prohíban expresarme y que esa decisión de censura no quede en manos de la compañía.” Agrega que es interesante porque puede limitar la autonomía de la compañía desde varios frentes.

“Los retos del consejo son enormes, el numero de solicitudes va a ser muy grande y hay procesos que van a provocar solicitudes que sobrepasan la capacidad del consejo.” Concluye.