Apple retrasa su tecnología para detectar la explotación sexual de menores

Estaba destinada a proteger a niños frente a individuos que usan este medio para contactarlos, así como para evitar la difusión de los contenidos

Herramientas de Apple contra la explotación infantil(EP / APPLE)

Apple ha retrasado unos meses la implantación de su tecnología para la detección y lucha contra la distribución de imágenes de explotación sexual de menores a través de servicios de la compañía como iCloud, e introducirá cambios antes de su lanzamiento.

La compañía estadounidense planeaba lanzar en las cuentas familiares de iCloud con iOS 15, iPadOS 15 y macOS Monterrey su nueva tecnología, que finalmente se retrasará unos meses debido a "comentarios de clientes, grupos de defensa, investigadores y otros", como ha reconocido Apple a través de un comunicado remitido a 9to5Mac.

"Hemos decidido tomarnos más tiempo durante los próximos meses para recopilar información y realizar mejoras antes de lanzar estas características de seguridad infantil", comentó un portavoz de la compañía.

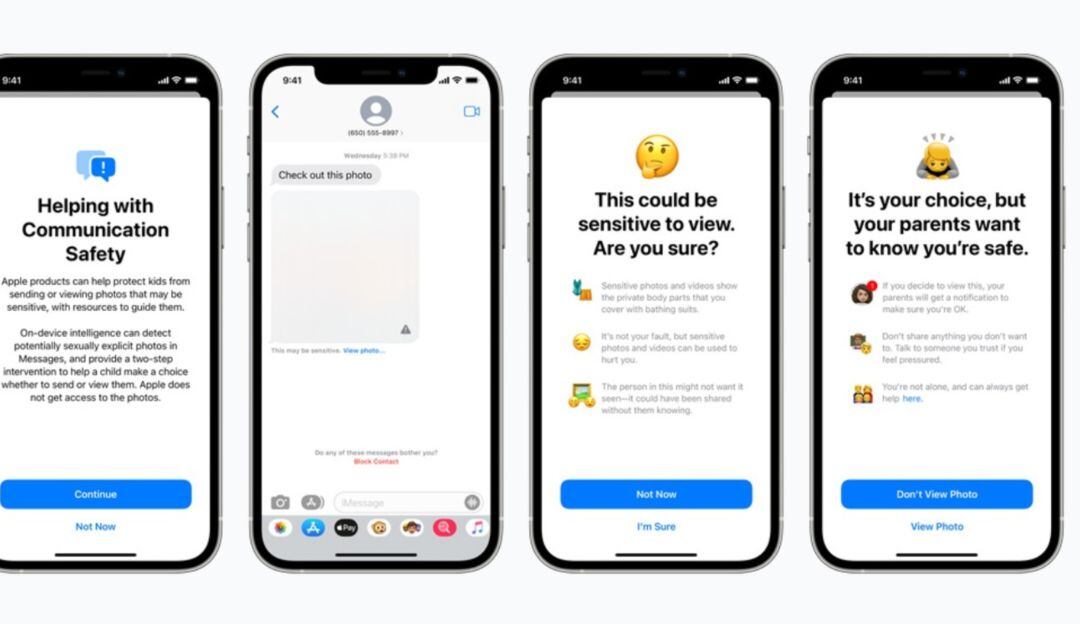

Esta tecnología, que Apple había anunciado en agosto pero que no había llegado a aplicar, estaban destinada a proteger a los niños frente a acosadores sexuales que utilizasen las herramientas de comunicación de la compañía para contactar y explotar a menores, así como a evitar la difusión de estos contenidos.

De igual forma, una segunda tecnología incluía en la app de mensajería Messages, los padres o tutores recibirán una notificación (opcional) cada vez que el niño envíe o reciba una imagen con contenido sexual explícito, pero esto ocurre después de que el niño reciba una advertencia en la que se informa sobre que si procede a ver dicha imagen sus padres serán notificados.

Por el momento, Apple no ha puntualizado cuándo se lanzará esta nueva tecnología tras su retraso ni en qué aspectos piensa cambiarla.